AI 漫剧创作系统是一个强大的创作平台,致力于帮助创作者通过 AI 技术轻松制作漫剧。无论您是否有绘画基础,都可以通过我们的智能工具,将脑海中的故事转化为精美的视觉作品。

核心 AI 功能

1. AI 剧本创作与分析

系统内置强大的语言模型,能够辅助您完成从创意到剧本的全过程。

2. 智能角色生成

保持角色一致性是漫剧创作的难点,我们的 AI 完美解决了这个问题。

- 自动生成角色

- 一致性保持:通过先进的特征锁定技术,确保角色在不同分镜、不同角度、不同表情下保持形象统一。

角色描述示例: "18岁少女,银色长发,穿着蓝白相间的水手服,眼神清澈,日系二次元风格。"

3. 场景与道具生成

- 自动生成场景:根据剧本描述自动生成高质量背景图,支持多种艺术风格(赛博朋克、水墨、日系动漫等)。

场景描述示例: "雨夜的霓虹街道,积水反射着红蓝色的灯光,高楼林立,充满未来感,电影质感。"

- 自动生成道具:生成高精度的道具素材,如武器、车辆、日常用品等,方便在分镜中灵活调用。

4. 自动分镜生成

这是系统最核心的功能,将文字剧本一键转化为可视化的分镜画面。

- 文本转画面:AI 自动理解剧本中的动作和对白,生成对应的分镜画面。

- 智能构图:自动选择最佳的镜头语言(特写、中景、全景、仰视、俯视等)来表现剧情张力。

- 风格统一

系统其他模块

1. 创作工具箱

- 多比例支持:支持 16:9, 9:16, 4:3, 3:4, 1:1, 21:9 等多种画面比例,适应不同发布平台。

- 全局 AI 风格

2. 资源管理

项目管理首页

登录系统后,您将进入我的项目页面。在这里,您可以查看和管理所有已创建的漫剧项目。

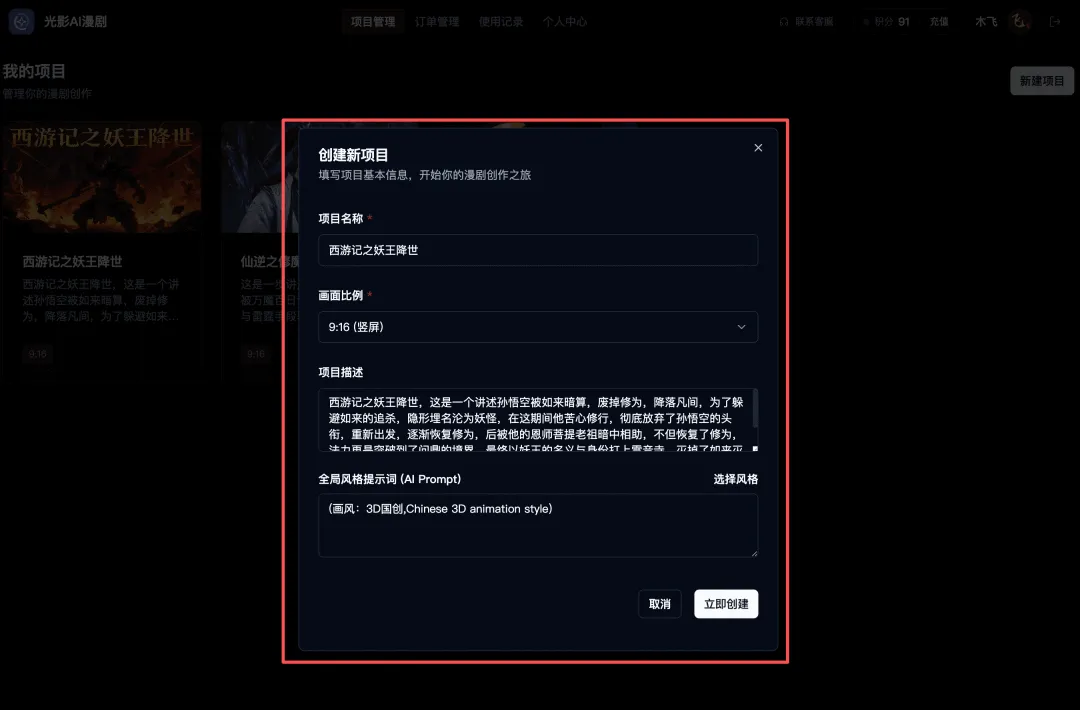

新建项目流程

点击“新建项目”后,将弹出创建对话框,请填写以下信息:

1. 基础信息

- 项目名称

- 画面比例(必填):根据发布平台选择合适的比例,支持以下格式:

16:99:16 (竖屏):适合 抖音、快手、TikTok 等短视频平台。4:33:41:1 (正方形):适合 Instagram 等社交媒体。21:9

- 项目描述:简单描述故事梗概,有助于 AI 理解您的创作意图。

2. 风格设置

- 全局风格提示词 (AI Prompt):定义整个项目的视觉风格。例如:“3D国创, Chinese 3D animation style” 或 “日系二次元, anime style”。

- 选择风格:点击右上角的“选择风格”按钮,系统提供多种预设风格供您直接使用,确保画面风格统一。

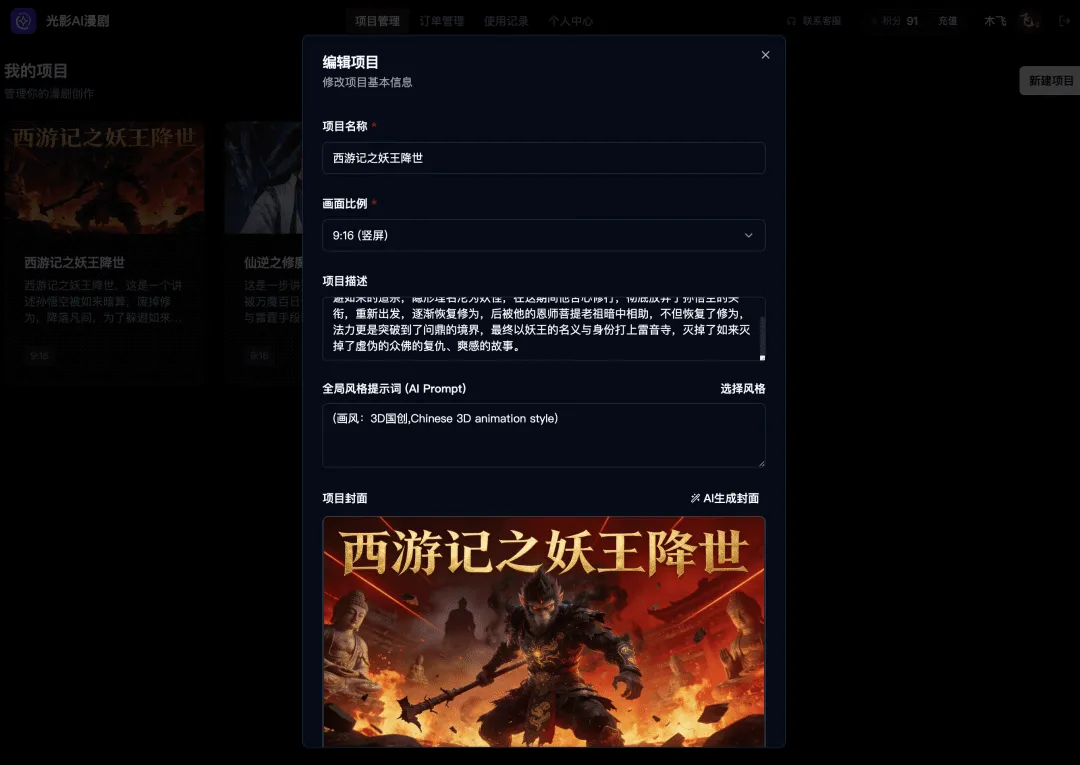

3. 项目封面

- 上传封面

- AI 生成封面:填写好项目名称和描述后,点击“AI生成封面”按钮,系统将根据您的描述自动生成一张精美的封面图。

填写完成后,点击“立即创建”即可进入项目创作工作台。

创建项目后,点击项目进入项目工作台。这是整个 AI 漫剧创作的核心枢纽,所有的创作步骤、资产管理和剧集编排都在这里进行。

工作台采用了直观的面板式设计,将复杂的漫剧制作流程拆解为清晰、易于操作的模块。

漫剧标准制作流程

在深入了解各个面板之前,我们先来了解一下使用本系统制作漫剧的标准工作流:

- AI 剧本创作

- AI 剧本分析:系统智能拆解剧本,提取出关键的角色、场景、道具,并为后续生成提供精准的提示词(Prompt)。

- 分镜拆解:自动将剧本转化为逐帧的分镜描述、台词及对应的画面生成提示词。

- 资产生成

- 画面融合:在分镜中,将角色与场景完美融合,生成单张静态分镜图。

- 图生视频:利用强大的 AI 视频生成模型,让静态的分镜图动起来,变成视频片段。

- 配音生成

- 分镜合成剧集:将所有动态的分镜视频和配音音频按照剧本顺序无缝拼接,最终合成一集完整的漫剧。

工作台面板概览

工作台主要由以下几个核心模块构成,点击每个面板上的操作按钮或卡片,即可进入对应功能的详细操作页面。

1. 剧集列表面板 (顶部)

这是您的“集数导航栏”。

- 功能

- 操作

- 点击每集下方的

AI 分析 按钮,启动该集的智能拆解。

2. 核心资产面板 (中部)

资产是漫剧的“血肉”,这里集中管理您的视觉元素。

- 角色 (Characters)

- 点击

创建角色 或 角色管理,进入角色定制页面,生成并锁定角色特征。

- 场景 (Scenes)

- 点击

创建场景 或 场景管理,构建风格统一的世界观。

- 道具 (Props)

3. 分镜管理面板 (中下部)

分镜是漫剧的“骨架”。

- 功能

- 展示:以卡片形式展示每个分镜的画面生成状态(图片数、视频数)。

- 操作:点击任意分镜卡片,或点击

分镜列表,进入强大的分镜编辑器,进行文本转画面、图生视频的精细化操作。

4. 配音管理面板 (下部)

配音赋予漫剧“灵魂”。

- 功能

- 展示

- 操作:点击配音管理入口,选择 AI 音色并输入台词,一键生成生动的角色配音。

5. 分镜合成面板 (底部)

这是创作的最后一步。

- 功能

- 状态:实时查看各集的合成进度(如“未生成”、“已生成”)。

- 操作:点击对应的剧集卡片,进入合成操作页面,一键输出您的漫剧大作。

提示:以上仅为工作台的结构概览。关于如何具体操作角色生成、分镜编辑、视频合成等功能,请参阅左侧菜单中的详细指南。

在项目工作台中点击“剧集列表”面板,即可进入剧集列表与剧本管理页面。这里是您组织漫剧结构、编写和分析剧本的核心阵地。

剧集管理

左侧边栏展示了当前项目的所有剧集。

- 添加剧集:点击左侧边栏顶部的“+ 添加剧集”按钮,可以快速创建新的集数。

- 切换剧集:点击列表中的任意一集,右侧工作区将切换到该集的剧本内容。

- 调整顺序:支持通过拖拽(如果系统支持)或修改序号来调整剧集的播放顺序。

剧本内容编辑

右侧工作区主要用于剧本的创作和编辑。您可以选择以下两种方式来完成剧本:

- 手动编写/导入:在下方的“剧本内容”文本框中,直接输入或粘贴您已经写好的剧本。

- AI 剧本创作:如果您还没有完整的剧本,可以在项目工作台首页点击“AI 剧本创作”按钮,输入创意大纲,让 AI 为您自动生成包含剧情梗概、角色列表和详细分镜的结构化剧本。生成后的剧本会自动填充到这里。

AI 剧本分析

剧本编写完成后,最重要的一步是剧本分析。

点击右上角的 “AI 剧本分析” 按钮(与工作台首页的分析功能一致),系统将弹出一个分析弹窗。AI 会深度阅读您的剧本内容,并自动完成以下工作:

- 提取核心元素

- 拆解分镜:将大段的剧本文字,逐句拆解为一个个独立的分镜画面描述、角色台词。

- 生成提示词:为每个提取出的元素和分镜,自动生成用于后续 AI 绘画的精准提示词(Prompt)。

提示:剧本分析是连接“文字”与“画面”的桥梁,是后续生成高质量分镜的基础。

资产绑定 (角色/场景/道具)

在剧本内容上方,您会看到“角色”、“场景”和“道具”三个资产绑定区域。

绑定的作用

这不是一个强制性操作,但强烈建议您使用。它的核心作用是提高分镜制作的效率和一致性:

- 清晰的元素清单:明确标注出当前这一集究竟出场了哪些人物、用到了哪些场景和道具。

- 便捷的素材调用:当您进入“分镜创作”流程进行画面融合(融图)时,这里绑定的资产素材会直接作为候选参考图出现。您无需再从庞大的全局素材库中翻找,直接点击即可作为参考图进行画面生成,大幅提升工作效率。

如何绑定

点击对应区域的 “+ 添加” 按钮,从已创建的项目资产库中选择当前剧集需要的角色、场景或道具即可。

在漫剧制作流程中,一个结构清晰、画面感强的剧本是成功的一半。为了降低创作门槛,系统提供了强大的 AI 剧本创作 功能。

在“项目工作台”的剧集列表面板,点击 “AI 剧本创作” 按钮即可打开创作弹窗。

操作流程

- 选择模型:系统集成了多种先进的大语言模型(如 Gemini、豆包 等)。不同的模型在逻辑推理和文笔风格上各有侧重,您可以根据需求选择合适的模型。注意:不同模型可能会产生不同的积分消耗。

- 输入创作需求:在输入框中详细描述您的故事大纲、核心设定或灵感片段。对于多集短剧,可以明确指定集数和每集的核心情节。描述越详细,AI 生成的剧本越符合您的期望。

示例:“请帮我创作一部3集的现代都市复仇爽剧。背景设定:男主五年前被未婚妻与挚友联手陷害破产并赶出家门。五年后,他成为全球最强财阀的幕后掌权人,强势回归。要求::剧情节奏极快,反转打脸要爽快利落。输出包含详细画面的分镜表,重点突出男主的从容霸气以及反派的震惊绝望。

- 开始生成

实时流式输出

剧本生成采用了流式输出技术。您无需漫长等待,AI 创作的过程会实时呈现在弹窗右侧的内容显示区域中。您可以像看打字机一样,直观地看到大纲、剧情、角色和分镜被一点点构建出来,随时掌控进度。

剧本内容结构

AI 自动生成的剧本不仅是一段故事,更是一套高度结构化的工业级生产指南。它通常包含以下几个核心模块:

- 本集剧情梗概

- 角色列表

- 场景列表

- 道具列表

- 剧本正文与分镜表:这是最核心的部分,AI 会将故事拆解为一个个具体的“镜号”,并提供详细的:

💡 核心设计理念:为 AI 绘画而生

特别说明:与传统的供人阅读的文学剧本或影视剧本不同,本系统 AI 生成的剧本是专门为“AI 生图”和“AI 生视频”量身定制的。

在传统剧本中,许多心理描写和抽象概念很难直接转化为画面。而我们的 AI 在创作时,会自动将这些抽象概念转化为具象的视觉描述。

例如,它不会写“他感到非常愤怒”,而是会写成 画面描述:特写,男子眉头紧锁,双眼布满血丝,牙关紧咬,背景色调暗红压抑。这种结构化、视觉化的剧本,能让后续的 AI 绘画和视频模型更准确地理解您的任务需求,从而生成高质量、高一致性的画面。

AI 剧本分析 是连接“文字剧本”与“视觉画面”的核心枢纽。在剧本创作完成后,系统通过深度阅读当前剧集的文本内容,自动提取出核心的视觉元素,并将其转化为可直接用于后续生成画面的数据。

在项目工作台的剧集列表中,点击任意剧集卡片上的 “AI 分析” 按钮即可唤起该弹窗。

核心分析模块

AI 剧本分析主要分为两大核心板块:元素提取 与 分镜拆解。在弹窗中,您可以自由勾选需要执行的分析任务。

1. 分析元素(角色、场景、道具)

- 功能描述:AI 会智能扫描剧本正文,提取出本集出场的关键人物(角色)、故事发生的环境(场景)以及重要的物品(道具),并为它们自动生成对应的 AI 生图提示词。

- 覆盖机制(覆盖现有角色/场景/道具)

- 勾选时:新分析出的元素将直接覆盖项目中已存在的同名数据(更新其设定和提示词)。

- 未勾选时:系统会自动进行去重处理。已存在的同名元素将被跳过,仅向资产库中添加全新的元素。

2. 分析分镜内容

- 功能描述:AI 会将大段的剧本剧情,按照视听语言的逻辑,逐段拆解为独立的镜头(分镜)。自动为每个分镜生成详细的画面描述、角色台词以及用于画面生成的生图提示词。

- 覆盖机制(覆盖现有分镜)

- 由于 AI 每次对剧本进行拆解时,生成的分镜总数量具有一定的随机性。

- 勾选时:新生成的分镜将从第 1 条开始,依次覆盖原有的分镜数据。

- 举例说明:假设当前集原本已有 10 条分镜数据,本次 AI 分析重新生成了 5 条新分镜。系统将用这 5 条新数据覆盖原有的前 5 条,而原有的后 5 条(第 6 至 10 条)将被完整保留。

⚠️ 资源安全提示 (非常重要)

在执行上述任何“覆盖”操作时,请您放心:

所有的覆盖操作仅针对“文本内容”(如提示词、画面描述、台词等进行更新)。您之前为这些角色、场景或分镜已经生成的图片和视频资源将被完全保留,绝不会因为重新分析文本而被删除或覆盖。

分析进度与完成状态

分析过程是自动进行的,弹窗中会实时显示分析进度(如:正在发现角色、正在发现场景等)。

当进度达到 100% 后,系统会展示本次分析的成果统计(例如:生成 2 个角色、2 个场景、2 个道具、X 个分镜)。此时,您可以关闭弹窗,前往工作台的对应面板查看并使用这些结构化数据了。

在漫剧创作中,统一且高质量的视觉资产是作品的灵魂。本系统将角色、场景和道具的制作流程进行了标准化统一。本教程将以“角色创作”为例,详细讲解如何从零开始制作这些关键元素。场景和道具的制作逻辑与此完全一致。

1. 元素列表管理

进入“角色管理”(或场景/道具管理)页面,您首先看到的是元素列表。

- 展示信息:列表清晰展示了每个元素的缩略图、名称、别名、生图提示词及创建时间。

- 管理操作:您可以在此对已有元素进行编辑、删除或创建新的元素。

2. 添加与编辑元素

点击右上角的 “+ 创建角色” 按钮(或列表中的编辑图标),将打开元素编辑抽屉。这里包含定义该元素的核心属性:

核心属性详解

- 名称与别名

- 生图提示词 (Prompt)

- 主体描述

- 作用:这是一段简练的自然语言描述(例如:“身穿银色铠甲的年轻战士”)。

- 重要性:当后续在分镜制作中进行“场景融图”或“视频生成”时,这段描述会被自动插入到画面的提示词中,以确保画面中的人物/物体特征保持一致。

- 素材图片

- 上传图片:如果您已有设计好的图片,可以直接点击“+ 上传图片”。

- 创作图片:如果您需要 AI 帮您设计,请点击 “创作图片” 按钮,进入强大的元素创作窗口。

3. AI 元素创作窗口 (文生图)

点击“创作图片”后,将打开 AI 文生图窗口。这是您发挥创意、塑造形象的工坊。

创作参数配置

- 选择模型:选择您喜欢的 AI 绘画模型(如 即梦, 豆包, Nano banana 等)。

- 参考图 (可选):如果您有类似的风格图或草图,可以上传作为参考,帮助 AI 更精准地理解您的构图或色调。

- 画面比例

- 提示词系统 (核心): 系统采用了独特的三层提示词结构,确保生成的图像既符合细节要求,又保持整体风格统一。

- 来源:项目创建时选择的风格(如“中国风”、“赛博朋克”)。

- 作用:控制项目整体的艺术风格。您可以在此点击“选择风格”重新修改。

- 最终指令:提交给模型的完整提示词 =

前置提示词 + 提示词 + 全局提示词。

- 前置提示词:通常用于强调画质(如

2k resolution, best quality)或特定的技术参数。 - 提示词:即您在上一级页面填写的“生图提示词”,描述角色的具体外貌特征。

- 全局提示词

生成与选择

- 立即生成

- 生成记录:生成的图片会实时显示在右侧的“生成记录”区域。系统会自动保存该元素的所有历史生成记录,方便您回溯。

- 确认使用:在多张生成结果中,点击放大预览,选中您最满意的一张,然后点击 “确认使用”。该图片将正式成为该角色的标准素材图。

分镜是漫剧的“骨架”,也是将文字转化为画面的关键步骤。在“分镜列表”中,您可以对每一条分镜进行细致的画面融合与视频生成操作。

界面概览

进入分镜列表后,界面主要分为以下几个部分:

- 剧集导航栏 (顶部):您可以左右滑动,快速切换当前编辑的剧集。选择剧集后,下方区域将更新为该集的内容。

- 分镜列表 (左侧)

- 分镜详情工作区 (右侧):点击左侧的某个分镜后,右侧会展示该分镜的全部详细信息,包括:

- 绑定的角色、场景、道具(如果在剧集列表中已绑定)。

画面融合 (融图)

画面融合的核心目的是将分离的“角色/道具”与“场景”完美结合成一张单帧图片。利用这张融合图去生成视频,可以确保人物角色在不同镜头中始终保持高度一致性,避免视频出现严重的“崩坏”或“换人”现象。

操作步骤

您可以通过点击“上传”直接使用本地图片,或者点击 “生成” 按钮打开融图创作窗口。

- 选择参考图:在左侧区域,您可以直接选择该分镜已绑定的角色、场景或道具图片作为参考图,让 AI 参考这些素材进行融合。

- 选择模型

- 提示词配置:与元素创作类似,分为前置提示词、提示词和全局提示词。系统通常会自动填充由“AI剧本分析”生成的该分镜的提示词。

- 生成与确认:点击生成后,右侧“生成记录”会显示结果。选中一张最满意的融合图片,点击右上角的 “确认使用”。这张图将作为后续生成视频的核心参考图。

视频生成

获得满意的融合图片后,接下来就是让画面动起来。在右侧工作区点击视频生成模块的 “生成” 按钮,将打开视频创作窗口。

创作模式 (顶部 Tab)

视频创作窗口提供三种强大的生成模式,以满足不同的动态需求:

- 文生视频

- 图生视频 (推荐):在文本提示词的基础上,增加选择一张参考图(通常选择上一步生成的“融合图片”)。这是保证漫剧角色一致性的最佳方式。

- 首尾帧:最高阶的控制模式。您可以同时指定首帧图片和尾帧图片,AI 会自动生成从首帧平滑过渡到尾帧的动态视频,非常适合制作特定的运镜或动作变化。

核心参数配置

- 提示词系统:包含前置提示词、提示词(描述画面动作与运镜)和全局提示词。

- 全局提示词用于控制项目整体风格,提交给模型的完整指令 = 前置 + 提示词 + 全局。

- 台词提示:当前分镜中人物或旁白的台词,部分支持声音生成的模型会利用此参数。

- 画面比例:根据您的发布平台选择(例如:手机端短剧选择

9:16)。 - 分辨率

- 视频时长 (秒)

- 声音:选择“有声”或“无声”(取决于当前选择的模型是否支持音频生成)。

- 随机种子 (Seed):用于控制生成内容的随机性。取值范围为

[-1, 2^32-1] 的整数。默认值为 -1,代表完全随机生成。如果您希望在相同提示词下复现某次生成的效果,可以填入该次生成的固定 Seed 值。

积分消耗规则与生成

视频生成是消耗算力较大的操作。底部的生成按钮会实时动态显示当前操作所需的积分。

积分计费规则: 不同的模型、不同的分辨率、不同的时长所需的积分均不相同。视频生成模型大多以生成的秒数来计费。通常情况下,分辨率越高、时长越长,所需的积分就越多。具体消耗请以生成按钮上实时显示的数值为准。

配置完成后,点击 “生成视频”。生成的视频会展示在右侧的“生成记录”中,您可以点击预览,挑选最满意的一个,点击 “确定” 完成该分镜的制作。

在完成分镜画面或视频的生成后,您可以在配音管理面板为每个分镜添加生动的角色配音或旁白。配音功能支持强大的 AI 语音合成,让您的漫剧角色开口说话。

界面概览

配音管理面板主要分为角色声音选择、台词编辑和配音生成等区域。

角色声音选择:

- 提供丰富的 AI 音色库供您挑选,涵盖不同的性别、年龄和情感风格。

- 操作:点击“选择音色”,在弹出的音色库中试听并选中合适的声音。

台词文本编辑:

- 这里会自动带入剧本中对应角色的台词。您也可以在此基础上进行修改或微调。

- 提示

生成与试听:

- 操作

- 生成完毕后,您可以在当前分镜下方直接试听配音效果。

音色库选择与声音克隆

点击“选择音色”后,会弹出音色库选择窗口。在这里,您可以为角色挑选或定制最合适的声音:

系统预设音色:

- 系统内置了海量的高质量默认音色,涵盖不同的性别、年龄段以及多种情感风格(如活泼、沉稳、激动等)。

- 您可以直接点击各卡片上的播放按钮进行试听,快速找到符合角色设定的声音。

声音克隆(自定义声音):

- 如果您想让角色拥有独一无二的声音(例如您自己的声音),可以使用声音克隆功能。

- 操作:只需上传一段清晰的语音文件作为样本,AI 便会智能分析并克隆该声音。克隆完成后,您就可以像使用系统音色一样,用这个专属音色来生成配音了。

配音操作流程

- 选择分镜与角色:在分镜列表中选中需要添加配音的分镜,并确认当前发音的角色。

- 选择 AI 音色:点击音色选择框,浏览并试听系统提供的音色,挑选最符合角色性格的声音。

- 编辑台词

- 生成配音:点击生成按钮。生成完成后,系统会自动将这段音频与当前分镜关联。

- 试听并调整:点击播放按钮试听,如果不满意,可以更换音色或调整台词文本重新生成。

提示:生成的配音音频将在后续的分镜合成环节中,自动与分镜视频对齐并合并到最终成片中。

在完成所有单个分镜视频的制作后,分镜合成是生成最终漫剧作品的最后一步。在这里,您将把一个个零散的镜头按照剧本顺序拼接在一起,并添加转场特效,最终输出完整的剧集视频。

界面概览

分镜合成页面主要分为左、中、右三个核心区域,以及顶部的全局设置栏。

分镜列表 (左侧):

- 如果某个分镜尚未生成视频,它将不会出现在此列表中。

- 操作:点击分镜卡片上的

+ 加号图标,即可将其添加到中间的视频轨道上。

全局设置栏 (顶部): 用于配置最终输出视频的整体参数。

- 比例:输出视频的画幅比例(如 9:16 或 16:9)。

- 分辨率:输出视频的清晰度(如 720p, 1080p)。

- 填充模式:当分镜视频的比例与最终输出比例不一致时,决定画面如何适配。支持包含 (Contain)、覆盖 (Cover)、拉伸 (Fill) 等模式。

- 全局转场:为所有相邻的视频片段设置统一的过渡特效(如淡入淡出、左推、无转场等)。

视频轨道 (中间): 这是您编排视频序列的工作区。

- 拖拽排序:您可以用鼠标按住视频卡片左右拖动,自由调整它们在成片中的播放顺序。

- 移除分镜

- 局部转场特效:在轨道上相邻的两个视频之间,有一个圆形的转场图标。点击它,会弹出转场特效选择菜单。

注意:优先级规则 如果您在这里为某两个视频单独设置了特定的转场特效(如“黑场”),那么该特效的优先级将高于顶部的“全局转场”设置。

成品预览 (右侧):

合成操作流程

- 添加分镜:在左侧列表中,依次点击

+ 将需要的分镜添加到中间的视频轨道。 - 调整顺序与转场:在轨道上拖动卡片确认播放顺序无误。根据需要,点击视频之间的圆形图标,为特定镜头设置独特的转场效果(如高潮部分使用“白场”闪过)。

- 确认全局参数

- 开始合成:点击右上角的 “合成视频” 按钮。

⏳ 耗时提示: 视频合成(尤其是高分辨率、多片段、带复杂转场的长视频)需要进行大量的云端渲染和编码计算,通常需要耗费一定的时间。请耐心等待,期间您可以离开此页面处理其他项目,合成任务会在后台继续运行。

- 预览与下载:合成完成后,右侧预览区会加载出最终成片。您可以点击播放检查效果,满意后点击“下载成品”即可。

当您的漫剧项目制作完成,或者需要将项目资源备份到本地时,可以使用项目导出功能。该功能允许您一键将项目中的所有核心资产(包括剧本、分镜图片、分镜视频、合成后的成品视频等)打包下载。

操作步骤

1. 进入项目列表

在系统首页(项目管理页面),找到您需要导出的项目卡片。

2. 唤起导出菜单

将鼠标悬停在项目卡片右上角的菜单图标(或更多操作按钮)上,在弹出的下拉菜单中选择 “导出项目”。

3. 等待打包

系统将自动弹出导出进度窗口,开始在云端为您打包资源。

- 导出日志:窗口下方会实时显示当前的打包进度日志(如:“正在处理第X集...”、“正在打包...”)。

- 包含内容

4. 下载文件

当进度条达到 100% 且显示“导出完成”后,点击右下角的 “下载文件” 按钮,即可将完整的项目资源包(ZIP 格式)保存到您的本地电脑中。

提示:生成的下载链接通常有有效期(如 24 小时),请在导出完成后及时下载。

在 AI 漫剧与视频创作的过程中,如何在不同的分镜、不同的场景下保持同一个角色外貌和服装的一致性,是一个非常核心且常见的挑战。本篇指南将为您详细介绍我们在系统中采用的“参考图”机制及其背后的原理。

为什么要保持一致性?

如果每个分镜都完全依赖文字提示词(Prompt)重新生成画面,AI 大模型每次都会“随机发挥”,导致同一个角色在上一秒和下一秒长得完全不一样(比如发型改变、衣服款式变化)。为了解决这个问题,我们需要在生成时给 AI 提供明确的视觉锚点(参考图)。

核心操作步骤:创建融图与生成视频

在分镜制作页面中,保持角色一致性的标准操作流程如下:

第一步:创建融图(角色与场景的融合)

首先,我们需要把单独生成的角色人物融合到对应的场景环境里,生成一张静态的单张画面。这张图片既包含了正确的场景背景,又包含了准确的角色形象。

第二步:使用融图作为视频生成的参考图

在开始生成视频(图生视频)时,必须将第一步生成的“融图”作为主要参考图提交给 AI 模型。

原理解析

因为这张融图里已经包含了您确认过的场景与角色,当它作为参考图传递给 AI 视频大模型时,它会在生成过程中获得极高的权重。AI 会严格按照这张图片的基础画面去推演运动轨迹,从而保证最终生成的视频与您设计的角色和场景高度一致。

进阶技巧:添加角色多视角参考图

除了上面提到的“融图”之外,为了让 AI 更全面地理解角色的立体特征(特别是当角色在视频中需要转身或有大幅度动作时),您还可以增加当前角色的多视角设计图作为辅助参考图片。

⚠️ 重要注意事项:控制参考图数量

在添加参考图时,切忌贪多!强烈建议总参考图数量不超过 3 张。

- 原理说明:参考图并不是越多越好。当您输入过多的参考图片时,AI 模型的注意力会被分散,单张图片的权重会被稀释。这会导致模型“不知道你的重点是什么”,最终不仅无法保持一致性,反而会生成结构混乱、不符合预期的视频画面。

- 最佳实践:1 张主场景融图 + 1~2 张最核心的角色多视角参考图。

通过合理地使用融图并控制参考图的数量,您就能在整部漫剧中保持角色形象的高度统一。

在使用 AI 大模型进行“文生图”或“参考图生成视频”时,您可能会偶尔遇到任务生成失败或被拒绝的情况。这通常是因为您的提示词(Prompt)或参考图触发了 AI 模型的安全审查机制。本篇指南将为您详细介绍这些限制的影响以及应对方法。

1. 为什么会触发限制?

各家 AI 大模型厂商为了遵守法律法规、伦理规范以及版权保护,都在底层内置了严格的安全与内容过滤系统。由于不同厂商的标准不同,某句提示词或某张参考图在 A 模型中可以正常生成,但在 B 模型中可能就会被拦截。

触发限制的主要原因通常分为两类:

- 敏感词拦截:提示词中包含了暴力、血腥、色情、政治敏感或具有歧义的词汇。

- 视觉特征拦截:参考图中包含了受严格管控的视觉元素,尤其是与“真实人类”高度相似的特征。

2. 现实真人风格的严格管控

目前,绝大多数主流 AI 模型对于**生成现实真人风格(Realistic Photo)**的内容都保持着极高的警惕性。这是为了防止深度伪造(Deepfake)、侵犯肖像权等潜在风险。

- 当您的提示词中包含“真实人物”、“摄影照片”、“明星姓名”等强烈现实风格的词汇时,被拦截的概率会显著增加。

- 在使用“图生视频”功能时,如果您提供的参考图是一张高度写实的真人照片,模型在进行面部特征提取时,也很容易触发风控机制导致生成失败。

3. Seedance-2.0 模型的特殊限制

在我们的视频生成环节中,如果您选择使用 Seedance-2.0 模型,请特别注意:

⚠️ Seedance-2.0 对“真人正脸”有极其严格的限制。

无论是在参考图片还是参考视频中,只要出现了清晰的真人正脸内容,Seedance-2.0 极大概率会直接拒绝该生成任务。这是该模型特有的严格风控策略。

建议: 在使用 Seedance-2.0 生成视频时,请尽量使用二次元、3D 建模、动漫插画等非真实人类风格的图片作为参考。如果您的项目必须使用真人写实风格,请尽量避免使用含有清晰真人正脸的素材,或者尝试切换到其他视频生成模型。

4. 遇到生成失败该怎么办?

当您遇到内容生成失败时,请不要气馁,可以尝试以下几个步骤进行排查和调整:

- 审查并修改提示词:检查提示词中是否存在可能引起歧义或触碰红线的词汇。尝试使用更中性、温和的同义词进行替换,然后重新提交生成。

- 更换参考素材:如果是在“参考图生成视频”环节失败,请检查参考图是否包含真人正脸或过于写实的画面。尝试更换一张风格更偏向二次元/3D的图片,或不包含敏感特征的图片。

- 调整艺术风格:如果您的漫剧项目非必须使用真人写实风格,建议在“全局设定”中切换到“动漫”、“3D”或“插画”等风格,这能大幅降低被拦截的概率,提高生成成功率。

Seedance 2.0 & 2.0 fast 是目前极具竞争力的视频生成模型,支持有声与无声视频的生成。本文将为您详细介绍该模型的核心能力、输入组合限制,以及在使用真人素材时的专属解决方案。

1. 模型核心能力

- 多模态参考生视频 (New)

- 输入:参考图片(最多6张)+ 参考视频(最多3个)+ 参考音频(最多3段)+ 文本提示词(可选)。

- 注意:不可单独输入音频,输入组合中应至少包含 1 个参考视频或 1 张参考图片。

- 图生视频 - 首尾帧

- 输入:首帧图片 + 尾帧图片 + 文本提示词(可选)。

- 图生视频 - 首帧

- 文生视频

2. 支持的输入组合

在使用多模态参考生视频时,Seedance-2.0 支持以下几种灵活的输入组合:

3. 提示词素材引用技巧

在参考生视频时,您可以在文本提示词(Prompt)中通过 “素材类型 + 序号” 的格式来精确指定需要引用的参考素材。序号即为您上传的同类素材的排列顺序。

引用格式示例:图片1、图片2、视频1。

完整提示词举例:

固定机位,近景镜头,清新自然风格。在室内自然光下,图片1中美妆博主面带笑容,向镜头介绍图片2中的面霜。博主将手里的面霜展示给镜头,开心地说“挖到本命面霜了!”;接着她一边用手指轻轻蘸取面霜展示那种软糯感,一边说“质地像云朵一样软糯,一抹就吸收”;最后她把面霜涂抹在脸颊上,展示着水润透亮的皮肤,同时自信地说“熬夜急救、补水保湿全搞定”。要求画面中人物居中,完整展示人物的整个脑袋和上半身,始终对焦人脸,人脸始终清晰,纯净无任何字幕。

通过这种方式,AI 模型能够精准理解不同参考素材在画面中应该扮演的角色,极大地提升视频生成的准确度。

4. ⚠️ 真人素材限制与合规解决方案

重要提醒:Seedance 2.0 系列模型不支持直接上传含有真人人脸的参考图或参考视频。为了便利创作者对肖像的合规使用,平台推出了以下两种解决方案:

方案一:信任模型产物作为输入素材(二次创作)

为了便利创作者在含人脸场景的二次创作需求,方舟平台信任该模型自身生成的含人脸产物。

- 规则:您可以使用本账号下近 30 天内由 Seedance 2.0 系列模型生成的含人脸原始视频或图片,作为输入素材,再次调用模型进行二次创作。

方案二:使用预置虚拟人像(系统内置)

为了方便用户快速上手,我们系统内部已经无缝集成了官方提供的虚拟人像库。

- 说明:在角色或参考图选择面板中,您可以直接选用系统内置的预置虚拟人像素材(每位虚拟形象由一张图片组成)。使用这些内置素材作为参考图生成视频,可以确保100%通过风控审核,无需担心版权与拦截问题。